TIMEX

Le jour ùu les androïdes ont remplace les humains. par transfert évolutif de la nature il y' a des millions d'années de cela et que ils ont crée un monde synthétisé cela a donné naissance à Jail Hell city wood , le studio de réalité virtuelle augmenté où la vie s'est transformé en un FreeFight de combats prpétuels pour la survie et le pouvoir dans vaste complexe scientifique construit par Parasol Corp Industry afin de recréer la vie jouable en utilisant des jouets, alors et née le "PLAYGROUND".

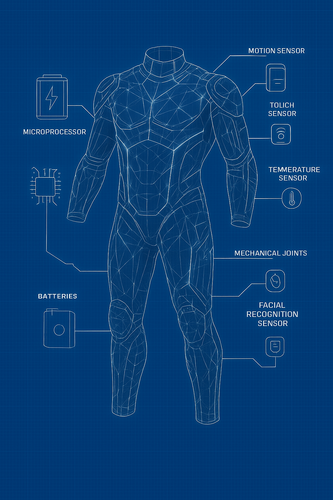

Système Androïd

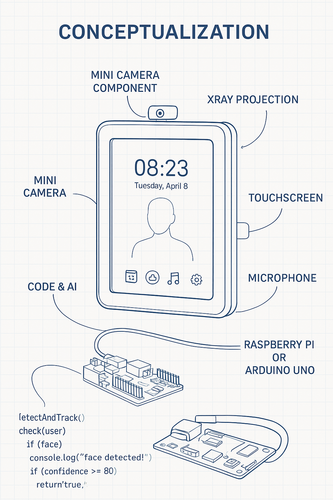

Projets Console XRAY:

Build Bill Architecture générale

-

Raspberry Pi : caméra, IA (reconnaissance faciale / vocale), serveur Web (Flask + SocketIO), interface vers microcontrôleur.

-

Arduino Uno (optionnel) : pilotage de capteurs physiques (boutons, LED, capteurs prox.), gestion tactile simple si tu utilises un contrôleur tactile dédié. Communique avec le Pi par Serial (USB) ou I2C.

-

Unity (optionnel / prototype) : interface 3D/affichage, peut demander données au Raspberry Pi via HTTP ou WebSocket.

-

HTML/JS : UI Web du miroir (peut tourner dans Chromium en mode kiosk sur le Pi).

-

Batterie : LiPo 1S + module charge TP4056 + circuit de protection + régulateur buck pour stable 5V vers Pi.

Raspberry Pi (Python) — serveur + IA (face detection + socket)

mirror_server.py

Installations (Raspberry Pi)

bash:

- sudo apt update

sudo apt upgrade -y sudo apt install -y python3-pip libatlas-base-dev libglib2.0-0 libsm6 libxrender1 libxext6 pip3 install flask flask_socketio eventlet opencv-python face_recognition numpy face_recognition requiert dlib en arrière-plan; sur RPi il peut être lourd. Sur Raspberry Pi 4+, possible mais prévoir compilation ou utiliser des wheels précompilés.

- Arduino Uno — capteurs/tactile simples + envoi série au Pi

Exemple : bouton d’activation, microphone analogique simple (détection niveau) et envoi Serial. - arduino_mirror.ino

- Fichier: cpp

- Raspberry Pi — lecture série Arduino + socket -> clients Web

Ajout au serveur Python (extrait) pour lire le serial et relayer:

Connecte Arduino en USB au Raspberry Pi; le Pi lira /dev/ttyACM0 ou similaire.

Raspberry Pi — lecture série Arduino + socket -> clients Web

Ajout au serveur Python (extrait) pour lire le serial et relayer:

python

Unity (C#) — consommer l’API du Pi (ex: snapshot + socket)

Option simple : appeler l’endpoint HTTP du Pi pour récupérer l’image et l’afficher.

PiClient.cs (Unity)

Fichier csSharp:

- Assigne un

RawImageUI pour l’affichage.

Pour communication en temps réel (SocketIO), utiliser un client SocketIO pour Unity (package tiers) ou faire polling HTTP.

HTML / Front-end (mirror UI)

Fichier : index.html

IA vocale (exemple minimal) — Raspberry Pi (speech-to-text)

Tu peux utiliser des bibliothèques comme SpeechRecognition (avec pocketsphinx) ou des services cloud (Google/Whisper). Extrait minimal (requiert micro, pyaudio):

python:

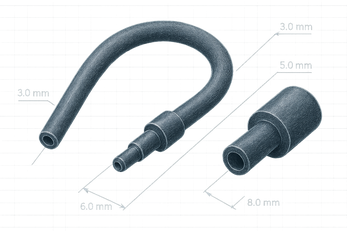

Alimentation / Batterie — composants & schéma

Objectif : alimenter Raspberry Pi + écran tactile + mini caméra + microcontrôleur. Idées fiables pour prototype :

Composants recommandés

-

Batterie : LiPo 3.7 V (1S) 5000–10000 mAh (selon autonomie souhaitée).

-

Module charge : TP4056 (charger micro-USB, pour 1S Li-ion) + breakout avec protection de batterie (BMS) — NE PAS connecter la batterie directement sans circuit de protection.

-

Boost/Buck : Si batterie 3.7V -> utiliser un step-up (boost) 5V 3A (ex : module basé sur MT3608 ou mieux) pour alimenter Raspberry Pi. Alternativement, utiliser une PowerBank de qualité qui sort 5V/3A.

-

Filtrage : condensateurs et fusible réarmable (PTC) 2–3A.

-

Option HAT UPS pour Raspberry Pi : si besoin de surveillance batterie et arrêt propre (ex : PiJuice style), mais pour prototype, un module UPS HAT ou un HAT de gestion d'alimentation.

-

Câblage : câble micro USB/USB-C 5V stable vers Pi ; caméra sur CSI ou USB selon caméra.

Schéma (texte)

-

Batterie LiPo 1S (+) -> BMS/Protection -> TP4056 chargeboard input (USB) pour recharger.

-

Batterie output -> Boost converter (5V out, >=3A) -> Raspberry Pi 5V input (USB-C or GPIO 5V + GND) (préférer USB-C ou alimentation via barrel jack).

-

Écran tactile : alimenté soit par le Pi via USB/HDMI/touch USB, soit par le même 5V boost (vérifier consommation).

-

Arduino : peut être alimenté par le Pi USB (pratique) ou séparément via 5V régulé.

Estimation de consommation (exemple)

-

Raspberry Pi 4 : 600 mA (idle) -> jusqu’à 1.5–2.5 A charge max selon usage.

-

Écran tactile 7" : 300–600 mA selon luminosité.

-

Caméra : < 200 mA.

=> Prévoir alimentation 5V @ 3A minimum pour stabilité.

9) Conseils d’intégration & sécurité

-

Toujours utiliser un circuit de protection batterie (BMS) pour éviter surcharge/décharge profonde.

-

Prévoir monitoring de la batterie (tension) via ADC (possible via Arduino) ou HAT dédié.

-

Implémenter arrêt propre du Raspberry Pi quand batterie faible (script qui surveille tension et appelle

sudo shutdown now). -

Pour la reconnaissance faciale, respecter la vie privée : informer les utilisateurs et stocker les données de manière sécurisée.

-

Pour la voix : si tu envoies du flux à des API cloud, attention à la confidentialité.

10) Exemples d’intégration supplémentaires (rapide)

-

Auto-start UI : configurer Chromium en kiosk sur le Pi pour charger

http://localhost:5000/au boot. -

WebSocket : utiliser

socketiocôté client (JS) et serveur (Flask-SocketIO) pour réactivité (déjà inclus). -

Sauvegarde des visages : un petit endpoint pour ajouter des visages connus : upload d’image -> compute encoding -> save file + encoding JSON.

11) Fichiers / snippets téléchargeables

Si tu veux, je peux :

-

Générer un dépôt d’exemples (arborescence + fichiers prêt à copier).

-

Te fournir le

requirements.txt, unsystemdservice file pour lancer le serveur au démarrage, et un script d’arrêt propre selon tension batterie.

BUILD RE@LGAME FIGURINES FBX

| Updated | 11 hours ago |

| Status | Prototype |

| Platforms | HTML5 |

| Author | ZpektrumXP |

Leave a comment

Log in with itch.io to leave a comment.